Mit einem Augenzwinkern.

Zielgruppe: Einzelunternehmer, wie Headhunter, Berater, Texter, kleine Agenturen (1-5 Personen)

Technisches Level: Anfänger bis Fortgeschritten (HTML-Kenntnisse ausreichend)

Zeitaufwand: 2-3 Stunden (inkl. Fehlerbehebung)

Kosten: 0 CHF für Kernfunktion (Analyse), optionale Kosten für Audio-Features

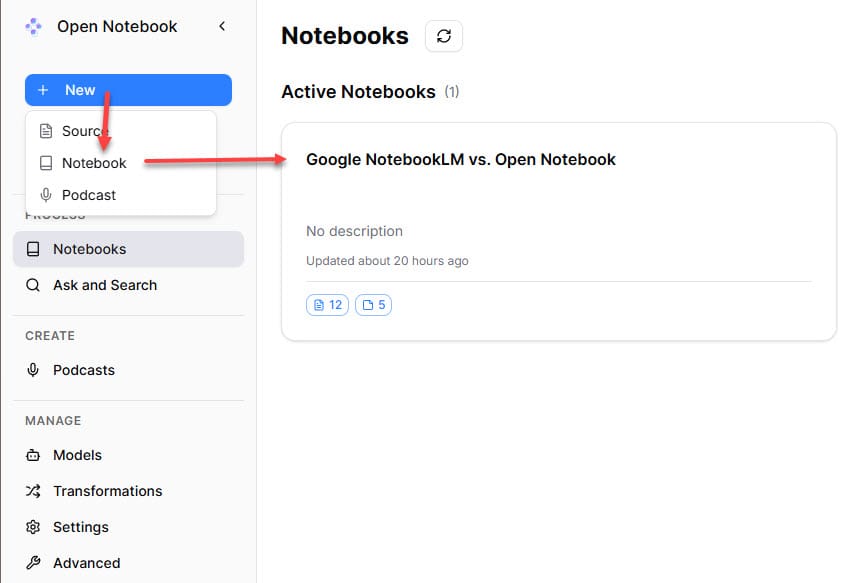

Open Notebook selbst installieren oder einen Experten beauftragen?

Ich bin keine IT-Expertin. Ich beherrsche HTML aus den 90ern, um eine Website zu erstellen. Ja, selbst die Buttons etc., denn als ich als Internet-Publisher bei der Studiengemeinschaft Darmstadt lernte, gab es noch keine Baukästen. Und mittlerweile sind 22 Jahre vergangen.

Ich kann CSS lesen; ich weiss, was ein <div> ist und wie ich Links setze. Aber Open Notebook war für mich Neuland.

Als ich beschloss, Open Notebook (die lokale Alternative zu Google NotebookLM) zu installieren, hatte ich zwei Optionen:

- Einen IT-Dienstleister beauftragen.

- Es selbst versuchen und dokumentieren.

Ich entschied mich für Option 2 und das hier ist das Protokoll für alle, die ähnlich denken: Inhaber von Einzelunternehmen, die ihre Daten kontrollieren wollen, aber wenig Budget für externe Experten haben.

Die gute Nachricht: Wenn Sie HTML verstehen (also: Struktur lesen, Tags erkennen und Fehler im Code finden können), dann haben Sie bereits das wichtigste Werkzeug. Docker-Compose-Dateien sind nichts anderes als strukturierte Texte, vergleichbar mit einer komplexen HTML-Seite, nur mit anderen Befehlen.

Voraussetzungen für die lokale Installation

Sie benötigen für diese Installation nicht zwingend:

- Einen Informatik-Studiengang

- Einen teuren Server (mein Setup läuft auf einem bestehenden Workstation-PC)

- Programmierkenntnisse in Python oder JavaScript

Sie benötigen:

- Einen halbwegs modernen Rechner (ab 16 GB RAM, besser 32 GB)

- Windows 10/11 oder Mac/Linux

- Docker Desktop (kostenlos herunterladen und installieren, funktioniert wie eine App)

- Ollama (kostenlos – die Engine für die KI-Modelle)

- Geduld und die Bereitschaft, Fehlermeldungen zu lesen (wie beim Debuggen von HTML, wenn ein Tag nicht schliesst)

Optional:

- Eine NVIDIA-Grafikkarte (beschleunigt die Antworten, ist nicht zwingend)

- Grundverständnis für Dateipfade (Wo liegt was auf meinem Rechner?)

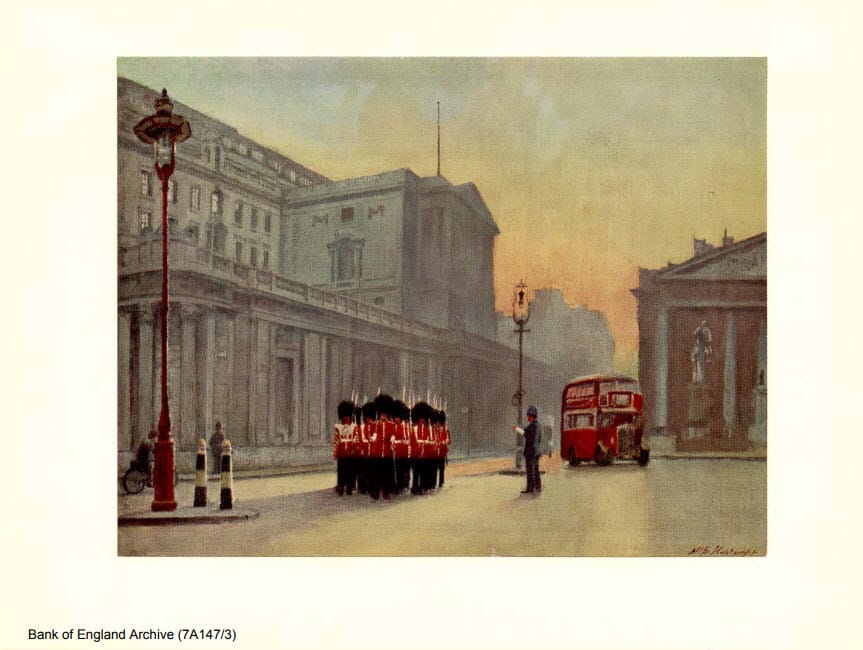

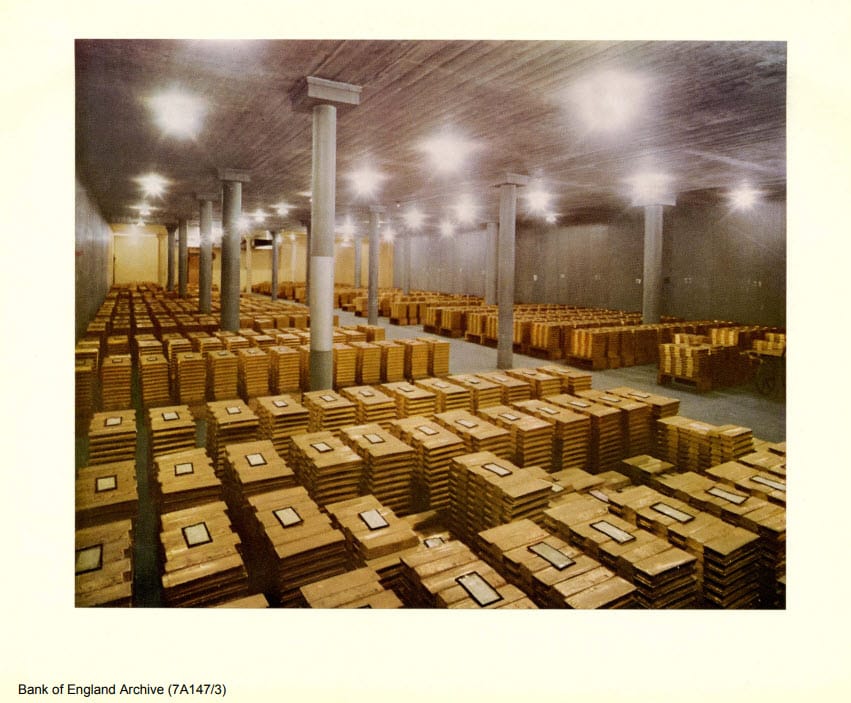

Die Bank-of-England-Sicherheit: Warum lokal?

| Bank of England (1867) | Cloud-KI (z. B. NotebookLM) | Meine lokale Lösung |

|---|---|---|

| 25 cm Stahl + Beton | „Verschlüsselte Server“ (Standort unbekannt) | Docker-Container mit Read-Only-Volumes |

| Einziger Schlüssel beim Besitzer | Hersteller hat „Zweitschlüssel“ (AGBs) | Nur ich habe den Schlüssel |

| Knackversuch = Alarm nach 5 Minuten | Datenleaks oft erst nach Monaten bekannt | Echtzeit-Logging + Air-Gapping |

„Die Bank of England vertraute nicht auf Versprechen. Sie baute Systeme, die Angreifer abschreckten. Meine lokale KI ist mein digitaler Tresor.“ — Manuela Frenzel

Die 5 Schritte (vereinfacht)

Schritt 1: Das Fundament legen (wie das Grundgerüst einer HTML-Seite)

Ich erstellte einen Ordner auf meinem Rechner:C:\Users\[Benutzername]\Documents\open-notebook-localDas ist mein "Workspace", vergleichbar mit dem Projektordner einer Website. Hier kommen später alle Dateien hinein.

Schritt 2: Die Konfigurationsdatei schreiben (die "index.html" unseres Systems)

Ich erstellte eine Datei namens docker-compose.yml. Das ist die Schaltzentrale, vergleichbar mit der index.html, die sagt: "Hier ist der Kopf, hier der Body, hier die Verbindungen."

Der Inhalt (stark vereinfacht dargestellt):yaml

# Das ist wie das <head> und <body> unserer Infrastruktur

services:

# Die Datenbank (unser Speicher)

surrealdb:

image: surrealdb/surrealdb:v2

# Das Webinterface (das, was wir im Browser sehen)

open_notebook:

image: lfnovo/open_notebook:latest

ports:

- "8502:8502" # Das ist wie ein Link: http://localhost:8502Was ich lernte: Die Einrückung ist wichtig, genau wie bei HTML, wo verschachtelte Tags eingerückt werden. Ein fehlendes Leerzeichen und nichts läuft.

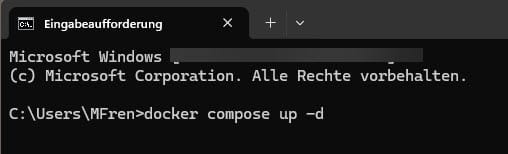

Schritt 3: Die Services starten (wie das Hochladen auf den Server)

Ich öffnete das Terminal (PowerShell) im Ordner und tippte:

docker compose up -d

Das war's. Docker lud das Nötige herunter und startete es, vergleichbar mit dem Upload einer Website auf einen Server.

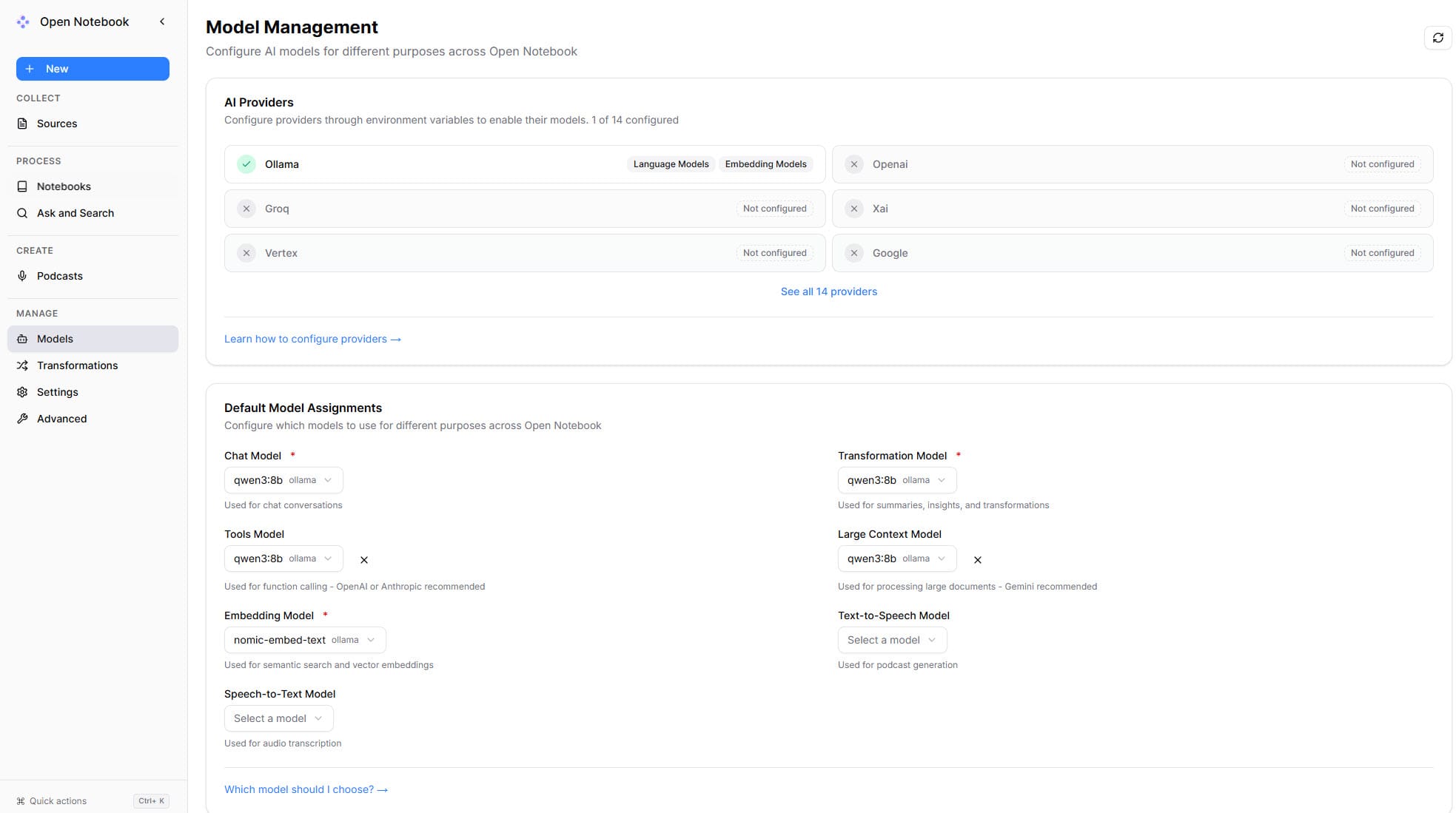

Schritt 4: Die Modelle konfigurieren (das CSS für die KI)

Nach dem Start wählte ich auf der Dashboardoberfläche in Open Notebook: "Welches KI-Modell soll es nutzen?"

Ich öffnete http://localhost:8502 im Browser (wie eine lokale Website) und ging zu Settings → Models.

Hier trug ich ein:

- Chat Model:

ollama/qwen3:8b(das Sprachmodell) - Embedding Model:

ollama/nomic-embed-text(für die semantische Suche)

Das ist vergleichbar mit dem Einbinden eines CSS-Frameworks: Man muss dem System sagen, welche Ressourcen es nutzen soll.

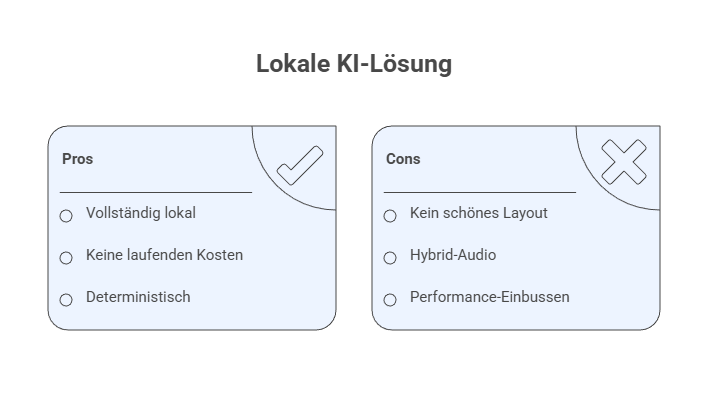

Ja, es gibt auch die Möglichkeit, Text-to-Speech oder Speech-to-Text einzufügen. Aber das bedeutet weniger Sicherheit und die Qualität der deutschen Sprache ist nicht überzeugend. Noch nicht. Deshalb halten wir es bei Text-zu-Text-Analysen und sind dafür sicher.

Das bedeutet, in dieser Version arbeiten wir Hybrid, Auswertung sicher lokal und für Podcasts oder Präsentationen, Quizzes eine Cloud-betriebene Plattform, wie Google NotebookLM, wenn man es wirklich braucht.

Schritt 5: Testen (wie das Überprüfen der Website im Browser)

Ich erstellte ein erstes "Notizbuch" und lud PDFs hoch. Dann stellte ich meine Fragen. Nach 3 Minuten erhielt ich die Antwort.

Mit einem kleineren Modell, wie Qwen 3:7b oder mit Deepseek könnte ich die Zeit noch optimieren, doch das würde jetzt hier den Artikel sprengen.

Die Fehler, die passierten (und wie ich sie löste)

Fehler 1: "Port 12345 (beispielhaft) already in use"

Was passierte: Ollama lief bereits auf meinem Rechner (ich hatte es schon installiert), und Docker wollte denselben Port nutzen. Denn ich nutze Ollama auch für lokale Chats.

Das war, als würde man versuchen, zwei Bilder mit derselben id zu versehen und das geht nicht, IDs müssen eindeutig sein.

Lösung: Ich änderte in der docker-compose.yml die Verbindung von http://ollama:12345 zu http://host.docker.internal:12345. Damit nutzte Docker die bestehende Installation statt einer neuen zu erstellen.

Fehler 2: Die Datenbank fehlte

Was passierte: Meine erste Version der docker-compose.yml enthielt nur den "open_notebook"-Service, nicht aber die Datenbank (surrealdb). Das war, als würde man eine Website bauen, aber den Server vergessen, auf dem die Daten liegen.

Die Fehlermeldung: Unable to Connect to API Server , vergleichbar mit einem 404-Fehler, wenn eine Seite nicht gefunden wird.

Lösung: Ich fügte den surrealdb-Block hinzu (siehe Schritt 2). Dabei half mir ein KI-Modell namens Kimi. Kimi stellte mir den richtigen Code zur Verfügung. Und was mich dabei überraschte? Beim ersten Mal den richtigen Code, nicht erst nach 5 Versuchen, wie ich es von anderen KI-Modellen kenne.

Wichtig: Die Reihenfolge spielt eine Rolle. Die Datenbank muss starten, bevor das Webinterface versucht, sich zu verbinden.

Fehler 3: Das Frontend fand die API nicht

Dann erhielt ich eine Meldung, dass es für Docker ein Update gibt. Nachdem ich Docker geupdatet hatte zeigte der Browser die Fehlermeldung, dass er den Server nicht erreichen kann. Und somit wurde mir Open Notebook nicht mehr angezeigt.

Analyse: Ich prüfte mit docker ps und sah: Die Container laufen, aber sie "sehen" sich nicht.

Lösung: Ich fügte die Zeile API_URL=http://localhost:5055 in die Konfiguration ein, vergleichbar mit dem Setzen einer base href in HTML, damit alle Links relativ zur richtigen Adresse funktionieren.

Das Ergebnis: Was jetzt möglich ist

Nach diesen 2-3 Stunden habe ich:

- Eine vollständig lokale KI-Notebook-Infrastruktur: Meine Mandantendaten verlassen meinen Rechner nicht.

- Eine Wissensdatenbank: Ihre Es ist auch möglich URLs einfzufügen.

- Keine laufenden Kosten für die Analyse: Im Gegensatz zu reinen Cloud-Lösungen fallen für die Kernfunktion (das Lesen, Analysieren und Verknüpfen von Dokumenten) keine API-Kosten an. Dies läuft vollständig lokal über Ollama.

- Optionale Flexibilität: Lokal: Piper/Kokoro, kostenlos, aber mit Qualitätseinbussen im Ton. Cloud: ElevenLabs/Azure, nur bei Bedarf, weil Sicherheit an erster Stelle steht.

- Kontrolle: Wenn ich den Stecker ziehe, ist das Notebook aus, keine Cloud und keine Abhängigkeit, die jederzeit abgeschaltet werden können.

Fazit für Einzelunternehmer

Wenn Sie HTML verstehen, können Sie auch selbstständig Open Notebook installieren. Die Docker-Compose-Datei ist nichts anderes als ein strukturiertes Dokument.

Die Investition von 2-3 Stunden lohnt sich: Sie erschaffen sich eine eigene Infrastruktur, die Ihnen gehört, und lernen dabei, wie moderne Systeme funktionieren.

Und wenn etwas nicht klappt? Die Community bei Open-Source-Projekten ist hilfsbereit. Oder noch einfacher, fragen Sie Ihre lokale KI nach Hilfe. Es ist beruhigend zu wissen, dass, wenn ich Analysen starte, sie lokal und auf keinem anderen Server sind.

"Vertrauen ist gut, Kontrolle ist besser", das wusste schon die Bank of England. Und jetzt weiss ich es auch.

Installieren Sie Ihr lokales Notebook für Analysen. Und danach schlafen Sie wie ein Bankdirektor, mit dem Wissen, dass Ihre Daten sicherer sind als das Gold in der Threadneedle Street.

Und falls etwas schiefgeht:

"Ein kleiner Trost aus der Historie: Selbst die Bank of England hatte mal einen Dieb. Aber die haben ihn gefasst. Und Sie haben docker logs." — Manuela Frenzel, jetzt offizielle "Banker’s Engineer" für lokale KI. Weil Vertrauen gut ist, lokale Hardware aber besser.Manuela Frenzel ist unabhängige Publizistin für Technologie und Gesellschaft.

Quelle der Bilder und der spannenden History von: The Bank Picquet, Its function and history 1963, The frontispiece is from a painting in the Bank Collection, THE GUARD MARCHES FROM THE BANK, 1939, by the late H. S. Kortright, R.B.A., a member of the Staff, Bank of England Archive (7A147/3)

Vertont mit Unterstützung von KI.